Apple LiTo : recréer des objets 3D depuis une seule photo

Apple dévoile LiTo, un modèle IA capable de reconstruire un objet 3D complet avec reflets et éclairages réalistes à partir d'une simple photo.

Vous prenez une photo d'un objet. Une seule. Et l'IA d'Apple vous recrée cet objet en 3D, avec les reflets, les highlights et les effets de lumière qui changent selon l'angle de vue. C'est exactement ce que fait LiTo, le dernier modèle de recherche sorti des laboratoires de Cupertino.

Un modèle qui comprend la lumière

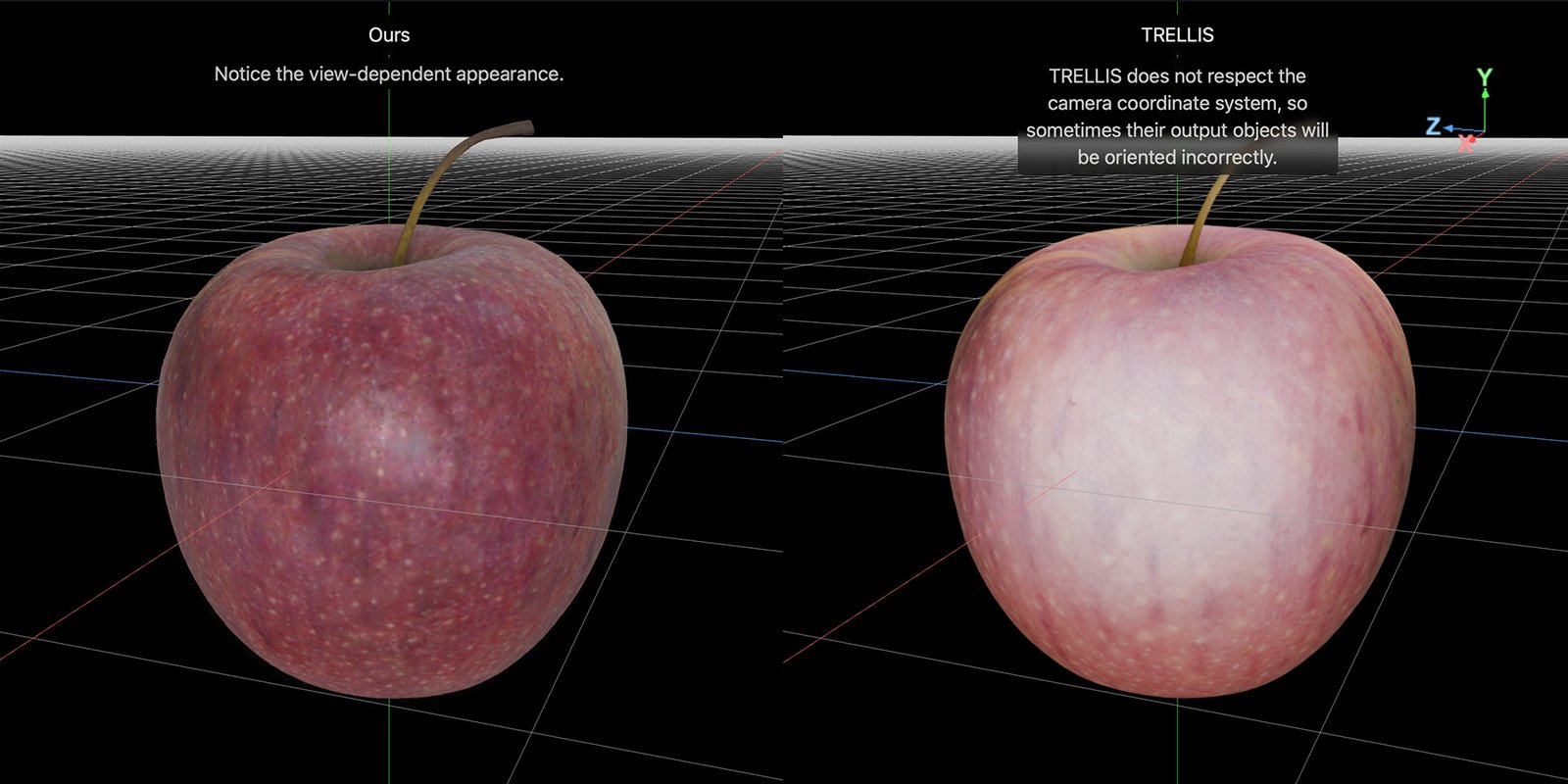

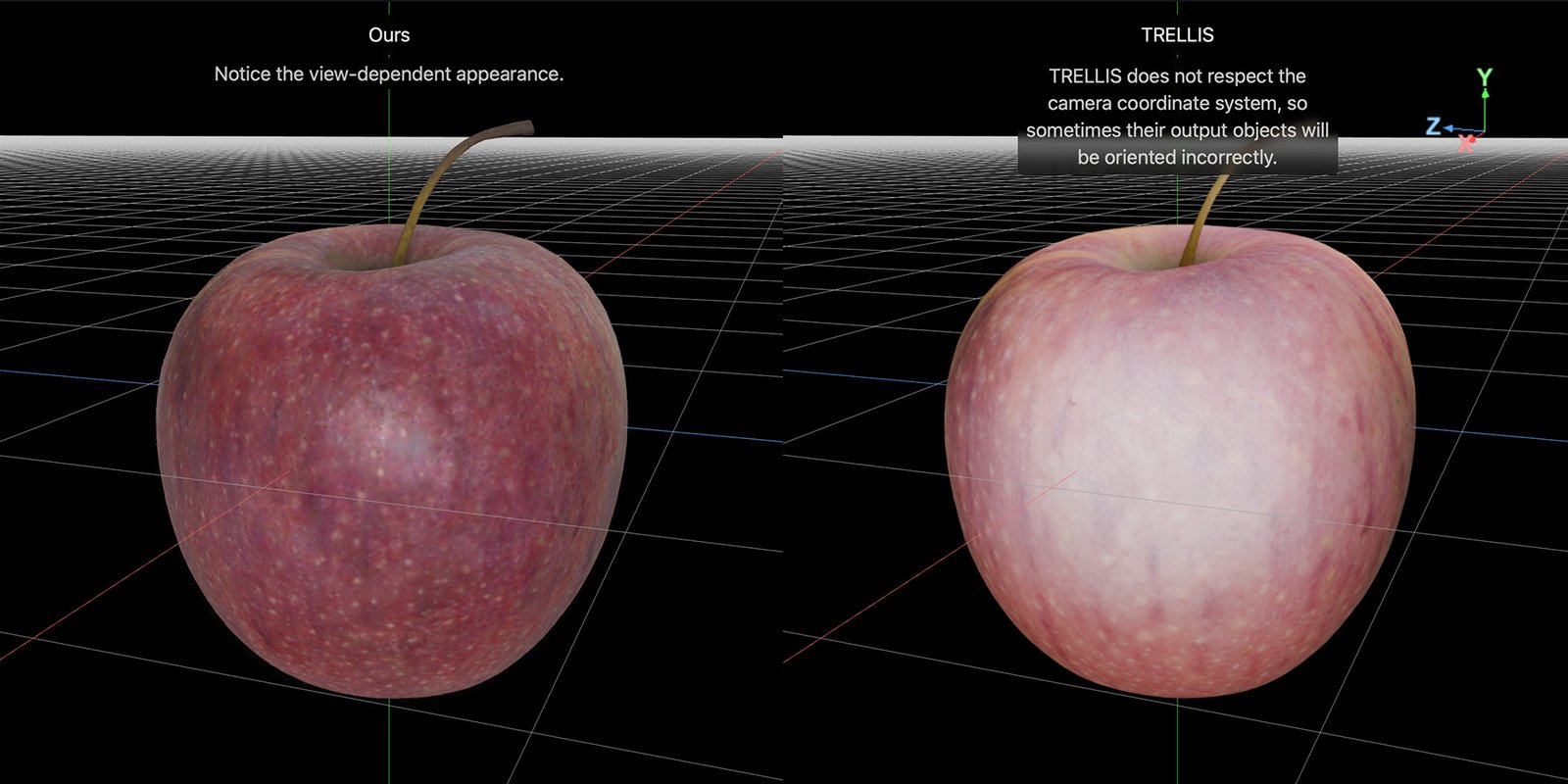

LiTo, pour « Surface Light Field Tokenization », s'attaque à un problème que la plupart des modèles 3D esquivent : les effets de lumière dépendants de l'angle de vue. Quand vous regardez un objet brillant, les reflets bougent avec vous. Un objet en verre change d'apparence selon votre position. La majorité des systèmes de reconstruction 3D ignorent ça et se contentent de reproduire une couleur plate et uniforme sur chaque surface.

L'approche d'Apple fonctionne en deux temps. D'abord, un encodeur compresse l'objet en une représentation compacte, une sorte de fiche d'identité mathématique qui capture à la fois la forme géométrique et la façon dont la lumière interagit avec les surfaces. Ensuite, un décodeur reconstruit l'objet complet à partir de cette fiche, en générant aussi bien la géométrie que les effets d'éclairage.

Le concept central repose sur l'espace latent. Pour simplifier, c'est un espace mathématique où chaque objet est représenté par un ensemble de nombres. L'exemple classique : prenez le mot « roi », soustrayez « homme », ajoutez « femme », et vous arrivez près de « reine ». LiTo applique cette logique aux objets 3D et à leur apparence lumineuse.

Comment Apple a entraîné LiTo

Pour apprendre à reconstruire des objets, les chercheurs ont rendu des milliers d'objets 3D sous 150 angles de vue différents et 3 conditions d'éclairage. Le système piochait des petits échantillons de ces rendus au hasard, les compressait dans son espace latent, puis le décodeur devait reconstruire l'objet complet à partir de ce fragment.

Au fil de l'entraînement, le modèle a appris à capturer les subtilités : comment un reflet spéculaire se déplace sur une surface laquée, comment les reflets de Fresnel apparaissent sur les bords d'un matériau transparent. Un second modèle a ensuite été entraîné pour prédire cette représentation latente à partir d'une seule image. C'est ce qui permet la reconstruction 3D complète depuis une simple photo.

Ce qui distingue LiTo des autres approches

La majorité des travaux précédents en reconstruction 3D se concentrent soit sur la géométrie pure, soit sur l'apparence avec un éclairage fixe. LiTo combine les deux dans un espace latent unifié. Le modèle ne se contente pas de deviner la forme, il comprend aussi comment la lumière se comporte sur chaque surface.

Les résultats montrent une nette amélioration par rapport aux méthodes existantes sur les effets dépendants de la vue. Les reflets spéculaires, les highlights et les effets de transparence sont mieux reproduits, surtout dans des scènes avec un éclairage complexe. Face aux NeRF classiques qui nécessitent plusieurs dizaines de photos sous différents angles, LiTo n'en demande qu'une seule.

Ce que ça pourrait changer

Apple n'a pas encore annoncé d'intégration dans ses produits, mais les applications possibles sautent aux yeux. Imaginez scanner un objet avec votre iPhone et obtenir un modèle 3D fidèle que vous pouvez manipuler dans un casque Vision Pro, avec des reflets réalistes qui réagissent à l'éclairage de votre pièce.

Pour les créateurs de contenu AR et VR, c'est aussi une avancée concrète. Créer des assets 3D photoréalistes prend normalement des heures de travail manuel. Pouvoir partir d'une simple photo pour obtenir un résultat exploitable, c'est un gain de temps considérable.

La recherche reste pour l'instant au stade académique. Mais chez Apple, la frontière entre la recherche et le produit peut être franchie assez rapidement, surtout quand le travail s'aligne avec la stratégie Vision Pro et la réalité augmentée.

FAQ

LiTo peut-il tourner sur un iPhone ?

Apple n'a pas communiqué sur les performances en temps réel ni sur le matériel requis. Pour l'instant, c'est un modèle de recherche qui n'est pas intégré dans un produit grand public. La compression en espace latent laisse toutefois penser que l'inférence pourrait être optimisée pour du matériel mobile à terme.

Quelle différence entre LiTo et les NeRF ?

Les NeRF (Neural Radiance Fields) nécessitent généralement plusieurs images prises sous différents angles pour reconstruire une scène. LiTo fonctionne à partir d'une seule image et encode spécifiquement les effets de lumière dépendants de l'angle, ce que les NeRF basiques gèrent moins bien.

Est-ce que LiTo gère tous les types de matériaux ?

Le modèle a été entraîné sur des milliers d'objets avec différentes conditions d'éclairage. Il gère bien les surfaces brillantes, les matériaux transparents et les effets de Fresnel. Les performances sur des matériaux très complexes comme le tissu ou les cheveux ne sont pas détaillées dans l'étude.

Quand cette technologie sera-t-elle disponible ?

Aucune date n'a été annoncée. C'est un article de recherche publié par les laboratoires d'Apple. L'intégration dans des produits comme Vision Pro ou les apps de réalité augmentée pourrait prendre plusieurs mois.

Crédit image : Apple / 9to5Mac

À lire aussi

AirPods Max 2 : ce qui change (et ce qui ne change pas)

Apple dévoile les AirPods Max 2 avec puce H2, ANC 1,5x plus efficace et audio lossless. Le point sur les nouveautés, le prix et ce qu'on en pense.

NVIDIA Vera Rubin : la puce IA la plus puissante jamais conçue

NVIDIA dévoile Vera Rubin au GTC 2026 : 336 milliards de transistors, 288 Go HBM4, 50 PFLOPS par GPU. L'architecture qui va dominer l'IA en 2027.

Questions fréquentes

LiTo peut-il tourner sur un iPhone ?

Apple n'a pas communiqué sur les performances en temps réel ni sur le matériel requis. La compression en espace latent laisse penser que l'inférence pourrait être optimisée pour du matériel mobile à terme.

Quelle différence entre LiTo et les NeRF ?

Les NeRF nécessitent généralement plusieurs images prises sous différents angles. LiTo fonctionne à partir d'une seule image et encode spécifiquement les effets de lumière dépendants de l'angle.

Est-ce que LiTo gère tous les types de matériaux ?

Il gère bien les surfaces brillantes, les matériaux transparents et les effets de Fresnel. Les performances sur des matériaux très complexes comme le tissu ou les cheveux ne sont pas détaillées.

Quand cette technologie sera-t-elle disponible ?

Aucune date n'a été annoncée. C'est un article de recherche. L'intégration dans des produits comme Vision Pro pourrait prendre plusieurs mois.