Nvidia abandonne le Rubin CPX au profit du Groq 3 LPU

Au GTC 2026, Nvidia enterre discretement le Rubin CPX et mise tout sur le Groq 3 LPU, un processeur d'inference SRAM qui redefinit le decode IA.

Il y a un an, Nvidia présentait une puce spécialisée appelée Rubin CPX pour accélérer les réponses de l'intelligence artificielle dans les centres de données. Ce lundi au salon GTC 2026, cette puce a tout simplement disparu des présentations. Comme si elle n'avait jamais existé. À sa place, quelque chose de complètement différent.

Groq 3 : la puce qui génère du texte à toute vitesse

Nvidia pousse désormais le Groq 3 LPU (Language Processing Unit, une puce spécialisée dans le traitement du langage). Cette puce vient du rachat de la startup Groq pour 20 milliards de dollars fin 2025.

Pour comprendre ce que fait cette puce, imaginez une usine qui fabrique des livres. Les GPU classiques (les processeurs graphiques, les puces habituelles de Nvidia) sont excellents pour *lire* et *comprendre* un texte d'un coup. Mais pour *écrire* du texte mot par mot, comme le fait une intelligence artificielle quand elle vous répond, il faut une approche différente.

Le Groq 3 est conçu exactement pour ça : cracher du texte mot par mot (ou plus précisément, "token par token", un token étant un morceau de mot) à une vitesse folle et avec un temps de réponse ultra-stable. C'est un peu la différence entre un lecteur rapide et un écrivain rapide. Les deux talents sont utiles, mais ce ne sont pas les mêmes muscles.

Deux puces pour deux étapes

Ce qui change fondamentalement, c'est que Nvidia sépare maintenant le travail en deux étapes distinctes avec deux types de puces différents.

La première étape, c'est la compréhension. Quand vous posez une question à une IA, elle doit d'abord lire et digérer votre texte en entier. C'est du calcul lourd, et les GPU classiques excellent là-dessus. Pensez-y comme un étudiant qui lit un gros dossier avant un examen.

La deuxième étape, c'est la génération de la réponse, mot après mot. C'est là que le Groq 3 entre en jeu. Il est optimisé pour cette tâche précise : produire du texte rapidement et régulièrement. Comme un orateur qui débite son discours sans hésiter.

Nvidia appelle cette approche la "désagrégation". Au lieu d'utiliser une seule puce pour tout faire (comme un couteau suisse), on utilise deux outils spécialisés, chacun excellent dans son domaine. C'est comme avoir un traducteur pour lire le texte étranger et un rédacteur pour écrire la réponse, plutôt qu'une seule personne qui fait les deux.

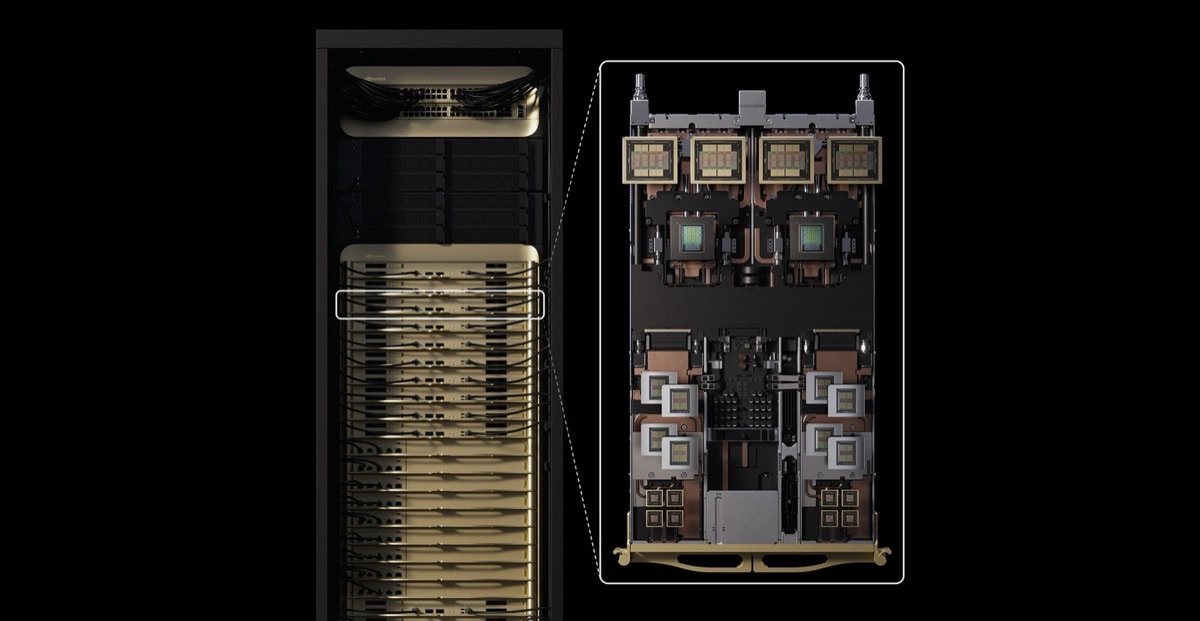

Une armoire informatique de 256 puces

Le Groq 3 ne vit pas seul. Nvidia l'emballe dans une armoire (un "rack") baptisée LPX qui contient 256 puces réparties sur 32 tiroirs refroidis par liquide. Le tout sans aucun câble interne.

Les performances de l'ensemble sont vertigineuses. Pour donner une idée : la combinaison des GPU classiques et des Groq 3 produit jusqu'à 35 fois plus de texte par unité d'énergie consommée que la génération précédente. C'est comme passer d'une voiture qui fait 5 litres aux 100 km à une voiture qui fait le même trajet avec un demi-verre d'essence.

Pourquoi c'est important pour vous

Concrètement, ça signifie que les assistants intelligents (comme ChatGPT, Claude, et tous les autres) pourront répondre plus vite et coûter moins cher à faire tourner. Quand le coût de production d'une réponse baisse, les prix pour les utilisateurs baissent aussi, ou bien les réponses deviennent plus longues et plus détaillées pour le même prix.

Nvidia cible les assistants vocaux, les copilotes de programmation, les agents intelligents autonomes : tout ce qui demande des réponses rapides et interactives.

La concurrence fait pareil

Nvidia n'est pas le seul à miser sur cette approche. Amazon Web Services (le plus grand fournisseur de services de cloud computing au monde) a annoncé un partenariat similaire avec Cerebras, une autre entreprise de puces spécialisées. Le fait que deux géants adoptent la même stratégie, séparer la compréhension et la génération sur des puces différentes, confirme que c'est la direction que prend l'industrie.

Le GPU qui fait tout, tout seul, pour l'intelligence artificielle, c'est peut-être en train de devenir un truc du passé.